L’intelligence artificielle (IA) est partout. Dans nos fils d’actualité, dans les discussions de nos salles de pause, et même dans nos téléphones qui nous demandent si nous voulions vraiment écrire “canard” au lieu d’un autre mot.

Mais au milieu de tout ce bruit, une question persiste : l’IA est-elle véritablement transformatrice, ou sommes-nous simplement emportés par une nouvelle vague technologique survalorisée ?

Selon l’interlocuteur, l’IA générative représente soit l’aube d’une ère dorée, soit l’équivalent numérique d’une huile de serpent.

Cet article et le webinaire dont il est tiré ne prétendent pas vous offrir une boule de cristal. Ce qu’ils promettent, c’est de la clarté. Nous plongeons au cœur de ce qu’est réellement la technologie IA aujourd’hui. Non pas la version de science-fiction, mais celle qui a un impact concret sur les entreprises. Nous explorerons comment l’IA générative transforme notre façon de travailler, quels pièges éviter, et comment réfléchir plus clairement à son rôle dans votre organisation.

Vous souhaitez aller plus loin ? Regardez la rediffusion complète du webinaire N2 “IA et gouvernance des données : comment exploiter la puissance de vos données d’entreprise”, animé par Frédéric Etheve, ex-COO d’OVH Cloud et maintenant Tech Exec à temps partiel, et Nicolas Delaby, co-fondateur et CEO de N2 Help & Solutions.

L’IA : entre cycles d’engouement et espoirs humains

L’IA fait partie de ces rares technologies qui se situent au carrefour de l’émotion et de l’intellect. Pour certains, elle représente une menace existentielle. Pour d’autres, un ticket d’or vers le nirvana opérationnel.

La réalité ? Elle est à la fois les deux et aucun des deux.

Comme l’électricité ou internet avant elle, l’IA est devenue un test de Rorschach pour les ambitions et les angoisses de notre société. Certains y voient une libération des tâches mondaines, d’autres craignent un avenir dystopique sans emploi. Pourtant, la plupart d’entre nous se situent quelque part au milieu. Prudemment optimistes, mais sceptiques face aux promesses exagérées.

L’astuce consiste à reconnaître que l’IA n’est pas une entité monolithique. C’est un spectre. Il va de l’automatisation basique (pensez aux filtres anti-spam) aux modèles d’IA générative époustouflants (bonjour, ChatGPT). Et comprendre où se situe une technologie sur ce spectre est essentiel pour utiliser judicieusement les outils d’IA.

De la bulle internet à l’IA : l’histoire se répète ?

Revenons à la fin des années 90. Internet était alors un Far West, et chaque entreprise ajoutait un “.com” à son nom pour voir sa valorisation s’envoler. Quelques années plus tard, la bulle éclate, les fortunes s’évaporent. Mais la technologie sous-jacente ? Elle est restée, elle a évolué et elle a tout changé.

Ça vous rappelle quelque chose ?

Aujourd’hui, l’IA générative se trouve à un carrefour similaire. Les investisseurs déversent des milliards dans des startups qui promettent la lune. Certains outils d’IA offrent des capacités renversantes. D’autres, pas vraiment. Mais voici le plus important : tout comme internet, l’IA n’est pas près de disparaître. L’écume peut s’estomper, mais les fondations sont solides.

Alors oui, il y a peut-être une bulle, dans les valorisations, dans le battage médiatique, dans les gros titres sensationnalistes. Mais cela ne signifie pas que l’IA elle-même soit creuse. Cela signifie que nous apprenons encore comment l’utiliser correctement, comment l’intégrer de manière significative, et comment nous assurer qu’elle résout de vrais problèmes plutôt que d’impressionner simplement la direction.

L’essor de l’IA accessible

Il fut un temps où, pour expérimenter l’IA, il fallait un doctorat en apprentissage automatique et une salle de serveurs qui faisait autant de bruit qu’une soufflerie. Aujourd’hui ? Un ordinateur portable et un esprit curieux suffisent.

L’émergence d’outils d’IA comme ChatGPT, DALL·E et Claude a complètement changé le paysage de l’IA. L’IA générative, notamment les grands modèles de langage (LLM) utilisant l’apprentissage profond et le traitement du langage naturel, a mis des capacités puissantes entre les mains des utilisateurs ordinaires. De la rédaction d’e-mails au brainstorming d’idées de startups, l’IA n’est plus réservée aux laboratoires : elle est dans votre poche.

Et il ne s’agit pas seulement de gadgets amusants ou d’astuces de productivité. Cette accessibilité marque un tournant décisif.

Quand une technologie devient grand public, elle crée un terrain propice à l’innovation à grande échelle. Plus de personnes qui expérimentent signifie plus d’applications d’IA inattendues et percutantes. C’est ainsi que les révolutions se produisent. Non pas dans des tours d’ivoire, mais dans les cuisines, les salles de classe et les bureaux.

Les données : la puissance cachée derrière l’IA

Si l’IA est le moteur, les données sont le carburant. Et pas n’importe quel carburant. Pensez à du carburant de fusée, hautement performant. Car au cœur de chaque modèle d’IA réussi se trouve une montagne de données, méticuleusement traitées, étiquetées, nettoyées et structurées.

La plupart des systèmes d’IA, de la détection de fraude aux recommandations de contenu, s’appuient sur l’identification de modèles dans de vastes ensembles de données. Ces modèles aident le système à “apprendre” et à prédire. Mais voici le hic : la qualité de ce que vous obtenez de l’IA dépend entièrement de la qualité des données que vous y mettez. Données médiocres, résultats médiocres, comme on dit.

C’est là que de nombreuses entreprises trébuchent.

Elles s’enthousiasment pour les promesses de l’IA mais oublient la plomberie, l’infrastructure de données qui fait fonctionner l’IA. Avant d’implémenter un algorithme, vous devez vous demander : avons-nous les bonnes données ? Sont-elles propres ? À jour ? Complètes ?

La gouvernance des données : le héros méconnu

Parlons de gouvernance. Non, pas celle qui implique des politiciens en costume. Nous parlons de gouvernance des données, le héros méconnu derrière les projets d’IA réussis. Considérez-la comme le livre de règles pour les données de votre organisation : qui les possède, qui y accède, comment elles sont stockées et comment elles sont protégées.

Sans une solide gouvernance des données, l’IA est comme une voiture de course sans volant. Vous pouvez aller vite, mais vous n’avez aucun contrôle. Et c’est une catastrophe qui n’attend que de se produire. La gouvernance des données garantit que les données sont fiables, sécurisées et disponibles pour les bonnes personnes au bon moment.

Une gouvernance efficace des données instaure également la confiance. Lorsque les gens savent que les données sont précises et protégées, ils sont plus enclins à les utiliser. Et lorsque les systèmes d’IA sont construits sur cette base de confiance, ils deviennent plus efficaces. Et beaucoup moins risqués. Ce n’est peut-être pas tape-à-l’œil, mais c’est fondamental. Et c’est ce qui distingue une véritable transformation d’un chaos numérique.

Aligner les cas d’usage de l’IA avec la maturité des données

Imaginez essayer de conduire une Formule 1 sur un chemin de terre boueux. C’est l’effet que produit le déploiement d’une IA avancée sur des systèmes de données immatures. L’une des plus grandes erreurs que commettent les entreprises est de mal aligner leurs ambitions en matière d’IA avec leur véritable état de préparation des données.

La maturité des données ne se résume pas à la quantité de données dont vous disposez. Il s’agit de la façon dont vous les gérez. Sont-elles structurées ? Sont-elles centralisées ? Vos équipes savent-elles où elles se trouvent et comment les utiliser ?

Les organisations disposant d’une gouvernance des données mature peuvent s’attaquer à des cas d’utilisation d’IA plus complexes. Celles qui n’en ont pas ? Elles devraient commencer petit et intelligemment.

Cet alignement est important car les systèmes d’IA, en particulier ceux qui font des prédictions ou prennent des décisions, ont besoin de données fiables pour fonctionner efficacement. Lorsque les données sont incohérentes, incomplètes ou dispersées dans des silos, les résultats deviennent peu fiables, parfois même dangereux.

Considérez la maturité des données comme le fondement de votre IA. Faites-le correctement, et le reste deviendra beaucoup plus facile.

Le business d’abord : éviter le piège de la technologie pour la technologie

Voici un scénario courant : une entreprise entend parler d’un nouvel outil d’IA générative et se précipite pour l’implémenter, pour réaliser plus tard qu’il ne résout aucun problème réel.

Ça vous dit quelque chose ?

La pensée centrée sur la technologie est séduisante. Les démonstrations sont impressionnantes. Les possibilités semblent infinies. Mais sans un cas d’utilisation métier clair, l’IA devient une dépense tape-à-l’œil plutôt qu’un atout stratégique. La clé ? Inverser le script. Commencez par le besoin métier, pas par la technologie.

Vous voulez réduire l’attrition client ? Améliorer les prévisions ? Rationaliser les chaînes d’approvisionnement ?

Parfait.

Définissez clairement ces objectifs, puis explorez comment l’IA peut aider. Lorsque vous mettez en avant la valeur commerciale, l’IA devient un outil de transformation. Lorsque vous mettez en avant le battage médiatique, elle devient une distraction.

L’échelle des cas d’usage de l’IA

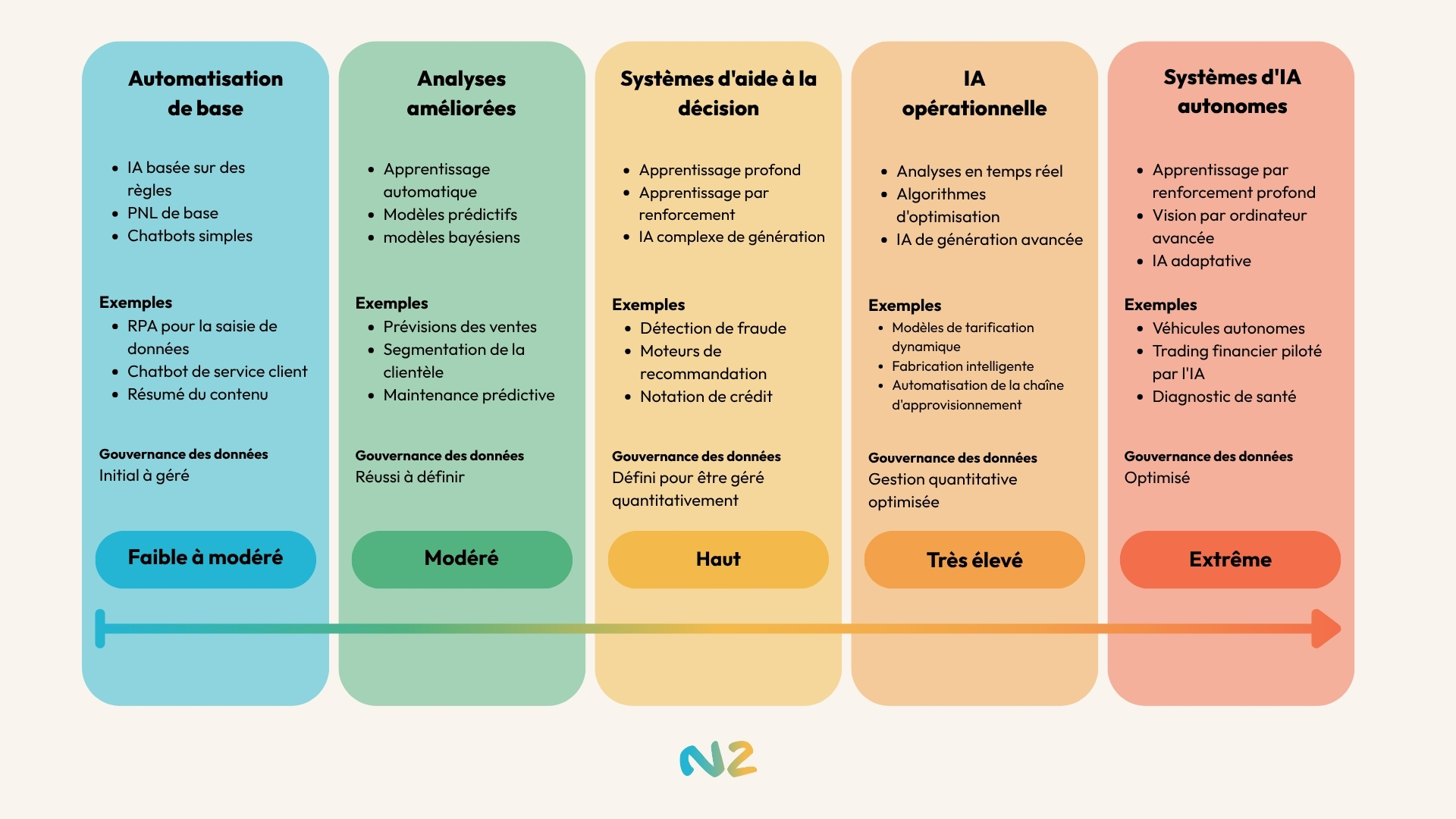

Tous les cas d’usage de l’IA ne se valent pas. Certains sont des évidences à faible risque et forte rentabilité. D’autres ? Pas vraiment. Comprendre où se situe un cas d’usage sur l’échelle de maturité de l’IA peut vous aider à déployer intelligemment et à éviter les mauvaises surprises.

Décomposons cela :

- Niveau 1 – Automatisation de base : Pensez aux chatbots qui répondent aux FAQ ou aux systèmes qui trient les e-mails entrants. Faible complexité, faible risque.

- Niveau 2 – Analyse améliorée : Outils qui résument des documents, catégorisent les clients ou génèrent des insights. Toujours supervisés par des humains, mais ajoutant une sérieuse efficacité.

- Niveau 3 – Aide à la décision : L’IA signale les transactions suspectes ou suggère les meilleures actions pour les équipes commerciales. Les humains prennent les décisions finales, mais l’IA oriente les choix.

- Niveau 4 – IA opérationnelle : Moteurs de tarification automatisés ou systèmes de maintenance prédictive qui agissent sans supervision constante. Risque plus élevé, récompense plus élevée.

- Niveau 5 – Autonomie complète : Voitures autonomes. Robots de trading autonomes. Ces systèmes fonctionnent indépendamment — et nécessitent des données et une surveillance irréprochables.

La conclusion ? Commencez là où votre organisation est prête. N’imposez pas des ambitions de niveau 5 à une infrastructure de niveau 2. Progressez régulièrement, et laissez vos réussites construire votre élan.

Humain vs. Machine : que faut-il automatiser ?

Ce n’est pas parce que quelque chose peut être automatisé que cela devrait l’être. L’un des défis les plus difficiles dans l’adoption de l’IA est de savoir où tracer la ligne entre l’intuition humaine et l’exécution machine.

Certes, l’IA peut rédiger des e-mails, analyser des rapports et même diagnostiquer des images médicales. Mais devrait-elle conclure une affaire ? Licencier un employé ? Gérer une négociation diplomatique à enjeux élevés ? C’est là que le contexte et les nuances humaines comptent plus que les algorithmes.

Les humains apportent l’empathie, le jugement et le raisonnement éthique. Des qualités que même l’IA la plus avancée peine à reproduire. Considérez l’IA comme un amplificateur, pas un remplaçant. Elle améliore nos capacités mais ne remplace pas (encore) ce qui nous rend humains. Les meilleurs systèmes ? Ils intègrent les personnes dans la boucle, ils ne les en excluent pas.

Éthique et conséquences : quand l’IA se trompe

Voici un constat réaliste : l’IA fait des erreurs. Parfois petites, comme recommander le mauvais produit. Parfois massives, comme signaler à tort des utilisateurs innocents comme fraudeurs ou diagnostiquer incorrectement un problème de santé.

La différence ? La réversibilité.

L’éthique de l’IA commence par la compréhension des enjeux. Si un chatbot alimenté par l’IA donne de mauvais conseils, les dommages sont mineurs. Si un véhicule autonome juge mal une situation, les conséquences pourraient être fatales. C’est pourquoi nous devons concevoir des systèmes d’IA avec à la fois prévoyance et dispositifs de sécurité.

Les organisations ont besoin de directives claires : quand faire confiance à l’IA, quand vérifier, et quand laisser les décisions entièrement aux humains. Elles ont également besoin de transparence. Les utilisateurs doivent savoir quand ils interagissent avec l’IA et quels sont les risques. Sans cette base éthique, même le système le plus sophistiqué peut devenir une source de problèmes.

Choisir la bonne infrastructure

Une fois que vous avez défini votre cas d’usage et évalué les risques, il est temps de se demander :

où réside votre IA ?

Ce n’est pas une question philosophique. C’est une question pratique. L’infrastructure que vous choisissez affecte tout, de la performance à la conformité.

Voici les trois principales options :

- APIs Cloud publiques (ex. OpenAI, Anthropic) : Rapides, faciles et puissantes, mais vos données quittent votre environnement. C’est rédhibitoire pour beaucoup dans la finance, la santé ou le gouvernement.

- Fournisseurs souverains (ex. Mistral, Aleph Alpha) : Hébergés en Europe ou dans votre pays, offrant plus de contrôle et d’alignement réglementaire.

- Déploiements sur site : Le Fort Knox des configurations d’IA. Vos modèles, vos serveurs, vos règles. Contrôle maximal, mais aussi coût et complexité plus élevés.

La règle d’or ?

Laissez le cas d’usage métier guider la technologie. Ne surengineérez pas un système de haute sécurité pour un chatbot à faible risque. De même, ne faites pas de compromis sur la conformité juste pour lancer rapidement. Des choix d’infrastructure intelligents commencent par des questions intelligentes.

Plaidoyer pour l’alphabétisation à l’IA

Voici la vérité : l’IA n’est plus réservée aux data scientists. Dans l’économie numérique d’aujourd’hui, tout le monde, des stagiaires aux dirigeants, a besoin d’une compréhension de base de comment fonctionne l’IA, ce qu’elle peut faire, et où elle peut se tromper.

Cela ne signifie pas transformer chaque employé en ingénieur ML maniant Python. Mais cela implique de construire un langage commun. Votre équipe commerciale comprend-elle comment l’IA évalue les prospects ? Le marketing peut-elle auditer un rapport généré par l’IA ? La direction peut-elle évaluer les risques liés à l’IA ?

L’alphabétisation à l’IA consiste à démystifier la boîte noire. Elle permet aux gens de poser les bonnes questions, de repérer les signaux d’alarme et d’utiliser efficacement les outils d’IA. Et c’est particulièrement vital pour les jeunes générations, qui grandiront en naviguant dans un monde façonné par des systèmes intelligents. Tout comme la culture numérique est devenue une compétence essentielle dans les années 2000, la culture IA est la prochaine couche essentielle.

Agents d’IA et LLM : ce que vous devez savoir

Parlons maintenant technique. Juste assez pour vous tenir informé lors de votre prochaine réunion. Vous avez entendu parler des LLM (grands modèles de langage). Ce sont les cerveaux derrière des outils comme ChatGPT. Ces modèles d’IA sont entraînés sur d’immenses ensembles de données textuelles et sont très doués pour imiter le langage humain.

Mais que se passe-t-il lorsque vous voulez que cette IA fasse quelque chose, comme annuler une commande, réserver une réunion ou extraire des données en temps réel ?

C’est là qu’interviennent les agents. Considérez un LLM comme l’esprit, et un agent comme les mains. Un agent utilise le résultat du LLM pour agir dans le monde réel (ou numérique).

Ces agents peuvent être étonnamment autonomes. Ils peuvent déclencher des workflows, manipuler des bases de données, et même parler à d’autres agents. À mesure que leurs capacités augmentent, le besoin de protections solides grandit aussi. Car lorsqu’un système passe de la parole à l’action, les enjeux se multiplient.

Écosystèmes multi-agents : avenir ou fantasme ?

Et si les systèmes d’IA pouvaient non seulement agir, mais collaborer ? C’est la promesse des écosystèmes multi-agents.

Imaginez : vous donnez une seule consigne, et en coulisses, un réseau d’agents d’IA se répartit les tâches, communique entre eux et exécute un processus complexe pendant que vous sirotez votre café.

Ce n’est pas de la science-fiction. Des outils comme Crew AI et LangChain prototypent déjà ces capacités. Un agent récupère les données. Puis, un deuxième les analyse. Enfin, un troisième envoie le rapport. Ajoutez des protocoles comme MCP (Multi-Agent Communication Protocol), et soudain vous avez une équipe numérique qui travaille en synchronisation. Plus rapide et (parfois) plus intelligente que les humains.

Mais voici le hic : la complexité. Plus d’agents signifie plus de points de défaillance potentiels. La coordination devient cruciale. La supervision devient plus difficile. Comme pour tout système puissant, la question clé n’est pas seulement de savoir si cela peut être fait — mais s’il devrait l’être, et comment il est gouverné.

Construire des organisations prêtes pour l’IA

Alors, comment préparer votre organisation à tout cela ? Les modèles, les données, la gouvernance, les agents. Cela peut sembler écrasant. Mais la feuille de route pour devenir prêt pour l’IA est étonnamment ancrée dans la réalité.

Commencez par la culture. Construisez une mentalité qui valorise l’expérimentation mais respecte le risque. Favorisez la collaboration entre l’IT, les données, la conformité et les unités commerciales. L’IA n’est pas seulement un projet technologique. C’est une transformation organisationnelle.

Ensuite, construisez l’échafaudage : une gouvernance solide des données, des rôles et responsabilités clairs, et une alphabétisation à l’IA dans tous les départements. Assurez-vous de pouvoir mesurer le succès. Pas seulement en termes de performance technique, mais en valeur commerciale.

Enfin, pensez de manière progressive. Pilotez. Apprenez. Mettez à l’échelle. N’essayez pas de tout “IA-tifier” du jour au lendemain. Au lieu de cela, identifiez des opportunités à fort impact et faible risque où l’IA peut démontrer sa valeur. Le succès dans un domaine créera un élan pour d’autres et la confiance dans toute l’organisation.

Conclusion

L’IA générative n’est pas une solution miracle. Ce n’est ni la fin du travail, ni la réponse à tous vos problèmes d’entreprise. Mais c’est un outil puissant. Et comme tous les outils, sa valeur dépend de comment, quand et pourquoi vous l’utilisez.

Les organisations qui réussissent avec l’IA ne sont pas celles qui courent après les tendances. Ce sont celles qui posent les bonnes questions, investissent dans des capacités fondamentales et construisent avec un objectif précis. Elles respectent les risques, mais ne craignent pas l’avenir.

Alors, l’IA est-elle une bulle ? Peut-être. Un mirage ? Dans certains contextes. Mais surtout, c’est une opportunité. Si vous êtes prêt à vous y engager de manière stratégique, éthique et intelligente. La révolution est réelle. Et elle a déjà commencé.

À mesure que l’IA continue d’évoluer, notamment dans des pays comme le Canada ou la France, où la recherche et l’implémentation de l’IA prospèrent, il est crucial de rester informé des derniers développements. Que vous exploriez ChatGPT au Canada ou que vous envisagiez des applications d’IA plus larges, rappelez-vous que le succès réside dans l’équilibre entre innovation et utilisation responsable. En se concentrant sur la qualité des données, la confidentialité et les considérations éthiques, les organisations peuvent exploiter la puissance de l’IA générative tout en naviguant dans le paysage complexe des réglementations et politiques d’IA.

FAQ

Les données sont cruciales pour l’IA, agissant comme un carburant de haute qualité. Les modèles d’IA réussis s’appuient sur des données bien traitées, propres et structurées pour des prédictions précises.

La gouvernance des données assure la fiabilité, la sécurité et l’accessibilité des données, établissant la confiance et l’efficacité dans les systèmes d’IA, prévenant le chaos numérique.

Les organisations devraient aligner les cas d’usage de l’IA avec la maturité des données, commencer par des besoins métier clairs et progresser de manière incrémentale pour assurer une intégration réussie de l’IA.